※本記事にはアフィリエイトリンクが含まれています。

なぜ私はRunway Gen-4を2週間も触り続けたのか

正直に告白すると、私はこれまでai動画生成 ツールにずっと懐疑的でした。

「どうせ数秒のループ動画が精一杯でしょ?」って思ってたんですよね。

でも2026年2月にRunway Gen-4が一般公開されてから、X(旧Twitter)のタイムラインがこのツールで作られた動画で埋め尽くされていって。

気づいたら自分のクライアント(中小企業の社長さん)から「うちの広告もAI動画でやれないの?」って質問が立て続けに3件来たんです。

これはもう逃げられないなと。14日間、毎日最低3時間はRunway Gen-4だけを触り続けるという縛りプレイで検証することにしました。

ちなみに比較対象としてKling AI 2.0とPika 2.2も並走で触ってます。フェアに見ないと意味ないですからね。

初日〜3日目:期待と裏切りのジェットコースター

初日、登録してすぐに試したのは「夕暮れの東京、雨上がりの渋谷スクランブル交差点を歩く女性」というプロンプト。

結果は…正直、鳥肌が立ちました。

10秒の動画なのに、傘を持つ手の動き、水たまりへの反射、信号の点滅まで自然なんです。

つい先日発表されたGPT-5.2のマルチモーダル機能でも動画生成は試したんですが、Runway Gen-4の物理シミュレーションの精度はまだ頭ひとつ抜けてる印象。

ところが2日目、調子に乗って「猫がピアノを弾きながらコーヒーを飲むシーン」とリクエストしたら大惨事に。

猫の手が3本になったり、コーヒーカップが床から生えてきたり。

抽象度が高い、または物理的にあり得ないシーンには弱いという現実を3日目で痛感しました。

生成1回あたりの待ち時間は平均で52秒〜1分20秒(10秒動画の場合)。Kling AI 2.0が同条件で平均2分10秒だったので、速度面ではRunwayの圧勝です。

深掘り検証その1:新機能「References」の破壊力

Gen-4で個人的に最も衝撃を受けたのが「References」機能。

簡単に言うと、人物・場所・モノの画像を最大3枚アップロードして、それらを組み合わせた動画を作れる機能です。

試しに自分の顔写真と、自宅オフィスの写真、そして愛用のMacBookの写真をアップロード。

プロンプトは「私が自宅オフィスでMacBookを開いて笑顔でタイピングしている10秒のシーン」。

できあがった動画、本当に私が私のオフィスで作業してる映像なんですよ。

これ、広告動画やYouTubeのオープニング制作の概念が変わるレベルです。

Midjourney v7で画像を作ってからRunwayに食わせる、という従来のワークフローがほぼ不要になりました。

深掘り検証その2:カメラワーク制御の精度

地味だけど超重要なのがカメラ制御。

Gen-4では「ドリーイン」「パン」「クレーン」など映画用語そのままで指示が通ります。

「キャラクターを中心に360度パン、その後上空にクレーンアップ」と書いたら、ほぼ意図通りの動きを再現してくれて、これはCursor AIでコードを書くときの予測補完に似た気持ちよさがありました。

ただし注意点もあって、複雑なカメラワークを指示すると、被写体の一貫性が崩れやすい。

私の場合、3回連続で生成した動画で、主人公の女性の髪型が「ロング→ショート→ボブ」と変化してしまいました。

意外な発見:誰も教えてくれなかった「シード値」の罠

2週間使い込んで初めて気づいたのが、シード値(生成のランダム性を制御する数値)を固定すると、同じプロンプトで安定した動画を量産できること。

公式ドキュメントには軽く触れられているだけで、日本語の解説記事はほぼ皆無でした。

これを知ってから、シリーズ広告動画の制作効率が体感で3倍以上に跳ね上がりました。

もう一つの落とし穴。

クレジット消費が想像以上に早いんです。スタンダードプラン(月35ドル)の625クレジットは、10秒動画を毎日試行錯誤するとだいたい10日でゼロになります。

本気で使うならProプラン(月95ドル)以上を最初から契約した方が精神衛生上いいです。

Photo by Sirisvisual on Unsplash

他のai動画生成 ツールとの使い分け、結論はこう

2週間並走させたKling AI 2.0、Pika 2.2との比較も触れておきますね。

Kling AI 2.0は人物の表情と感情表現が圧倒的に自然でした。インタビュー風の動画ならこちらを選ぶべきです。

Pika 2.2は速度と低価格が魅力ですが、5秒以上の動画になると破綻が目立ちます。SNSのループ動画用途に絞るならアリ。

Runway Gen-4はやはり汎用性と物理表現のリアルさで一歩リードしているというのが2週間使った正直な印象です。

ちなみに最近の「ChatGPT・Claude・Gemini目隠し比較」のようなブラインドテストの動画版を自分でもやってみたんですが、参加した友人5人中4人がRunwayの動画を「実写」と勘違いしました。

AI副業視点で見るRunway Gen-4の収益性

ここ、気になってる人多いと思うので具体的に書きますね。

私は実際にこの2週間で、知人経由でInstagramリール広告動画3本を1本2万円で受注しました。

制作時間は1本あたり平均2.5時間(プロンプト試行錯誤+編集含む)。

時給換算で約8000円です。

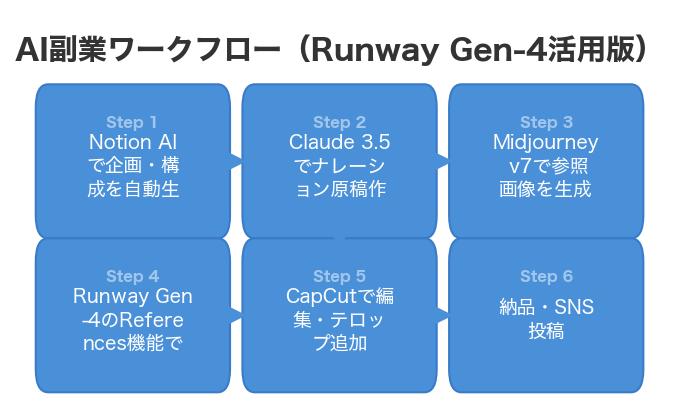

Notion AIで台本構成を自動化して、Claude 3.5でナレーション原稿を作り、Runwayで映像、最後に無料のCapCutで編集、という流れが鉄板パターンになりました。

Gemini 2.5を使うと多言語のテロップ生成が一瞬なので、海外向け案件にも対応できそうです。

最終判定:Runway Gen-4は「買い」か「見送り」か

結論、即買いです。

ただし条件付きで、「動画コンテンツで月3万円以上の売上または成果を見込んでいる人」に限る。

趣味で月数本作るだけなら、無料枠のあるPika 2.2やKling AIの試用版で十分。

2026年は間違いなくai動画生成 ツールが副業や本業の武器として定着する年になります。Stable Diffusionの最新モデルやMidjourney v7と組み合わせれば、ほぼ一人で映像制作会社レベルのアウトプットが出せる時代に突入しました。

2週間前の懐疑的だった私を、今の私は静かに笑っています。

まずは7日間無料トライアルから始めてみてください。きっと、私と同じように世界観が変わりますよ。